Das vom Bundesministerium für Verkehr (BMV) im Rahmen des mFUND geförderte Forschungsprojekt ADAM – Advanced Airspace Mapping verfolgt das Ziel, die Grundlagen für eine sichere, skalierbare und zertifizierbare Nutzung des unteren Luftraums durch unbemannte Luftfahrtsysteme (UAS) zu schaffen. Der Projektzeitraum erstreckt sich von September 2023 bis August 2026, Koordinator ist das Fraunhofer-Institut für Verkehrs- und Infrastruktursysteme IVI in Dresden.

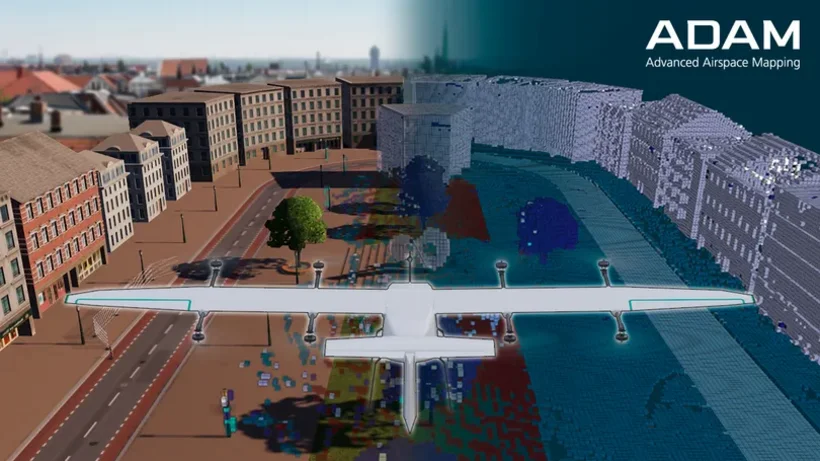

Im Zentrum steht die Entwicklung einer dreidimensionalen, semantisch angereicherten Luftraumrepräsentation, die als Basis für automatisierte Flugplanung, Flugüberwachung und operationelle Sicherheitsanalysen dienen soll. Das System basiert auf der Idee, die klassische „On-Board-Sensorik-zentrierte“ Wahrnehmung durch eine umgebungsbasierte, vorverarbeitete Datengrundlage zu ergänzen. Dadurch können unbemannte Luftfahrtsysteme (UAS) auf geprüfte 3D-Karten zugreifen, die bereits Hindernisse, Geländeformen und wichtige aktuelle Luftrauminformationen enthalten – eine sogenannte „Map-based Perception“, bei der das System seine Umgebung nicht nur mit Sensoren wahrnimmt, sondern zusätzlich auf detailliertes Kartenwissen zurückgreift.

Technologisches Konzept

Das Kernkonzept von ADAM besteht in der Erzeugung sogenannter Voxelkarten (Volumetric Pixel Maps). Diese Karten bilden die Umgebung in Form eines 3D-Rasters ab, bei dem jede Voxelzelle (Volumenelement) Informationen über physikalische Objekte und semantische Attribute enthält. Dazu gehören u. a. die Klassifikation (z. B. Gebäude, Vegetation, Leitungen), geometrische Merkmale (z. B. Höhe, Ausdehnung), Materialeigenschaften (z. B. reflektierende oder absorbierende Oberflächen) sowie Unsicherheitsmetriken.

Die Erstellung dieser Karten erfolgt durch eine multisensorielle Datenerfassung. Zum Einsatz kommen sowohl Luftsensorplattformen (z. B. Drohnen mit LiDAR-Scannern und RGB-Kameras) als auch bodenbasierte Sensormodule und existierende Geodatendienste (z. B. Geländemodelle, Katasterdaten, OpenStreetMap). Die Datenströme werden anschließend durch ein mehrstufiges Data-Fusion-Framework verarbeitet. Dabei kommen Verfahren der Simultaneous Localization and Mapping (SLAM), der Bayes’schen Sensordatenfusion sowie KI-gestützter Objekterkennung zum Einsatz.

Ziel ist es, aus heterogenen Datenquellen eine konsistente 3D-Darstellung der Umgebung zu rekonstruieren, die sowohl geometrisch präzise als auch semantisch vollständig ist.

KI-basierte Annotation und semantische Modellierung

Ein wesentlicher Innovationsaspekt von ADAM ist die automatische Annotation der Karten mittels künstlicher Intelligenz. Hierbei werden neuronale Netze, insbesondere Convolutional Neural Networks (CNNs) und 3D-U-Net-Architekturen, eingesetzt, um Objekte in den Sensordaten zu erkennen und klassifizieren.

Ein Beispiel: Ein LiDAR-Scan erfasst Punktwolken, aus denen zunächst Flächen und Strukturen extrahiert werden. Ein trainiertes Modell erkennt dann charakteristische Muster (z. B. Dachformen, Vegetationshöhen, Masten) und weist sie semantischen Klassen zu. Diese werden mit zusätzlichen Kontextdaten (z. B. aus GIS-Systemen oder Luftfahrtinformationsdiensten) angereichert. Das Ergebnis ist eine semantische 3D-Szene, die nicht nur die physische Umgebung abbildet, sondern auch für Flugsteuerungsalgorithmen interpretierbar ist.

Darüber hinaus werden Unsicherheitsmetriken berechnet, um die Zuverlässigkeit der kartierten Informationen zu quantifizieren. Diese Informationen sind essenziell für sicherheitskritische Anwendungen wie automatisierte Flugpfadberechnung oder „geo-fenced“ Zonenmanagement im U-Space.

Integration in U-Space und UTM-Systeme

Die im Rahmen von ADAM generierten Daten werden nicht isoliert betrachtet, sondern in bestehende UAS Traffic Management (UTM)-Infrastrukturen integriert. Dabei arbeitet insbesondere die Droniq GmbH an der Schnittstelle zwischen den ADAM-Daten und der operationellen Luftraumüberwachung.

Ziel ist es, die 3D-Karten als Geo-Awareness-Service in das U-Space-Service-Ökosystem einzubetten. Das bedeutet, dass Piloten und automatisierte Flugsteuerungssysteme Zugriff auf ein dynamisch aktualisiertes 3D-Modell des Fluggebiets erhalten. Dieses Modell kann u. a. folgende Informationen enthalten:

- Hindernisverteilungen und Sicherheitsabstände,

- temporäre Sperrflächen und Flugverbotszonen,

- Luftverkehrsstrukturen (z. B. Korridore, U-Space Volumes),

- Wettereinflüsse und Funkabschattungen.

Technisch wird hierfür eine standardisierte REST-API entwickelt, über die autorisierte Nutzer Kartendaten in Echtzeit oder Near-Real-Time abrufen können. Für die Datensynchronisation kommen Georeferenzierungs- und Versionierungsmechanismen zum Einsatz, die sicherstellen, dass alle Akteurinnen und Akteure stets auf konsistente Datensätze zugreifen.

Demonstratoren und Validierung

Ein Schwerpunkt der Projektarbeit liegt auf der praktischen Validierung der Technologie. Hierzu werden reale Flugversuche mit autonomen Drohnenflügen Beyond Visual Line of Sight (BVLOS) durchgeführt. Dabei wird untersucht, wie präzise und zuverlässig die Karteninformationen zur Hindernisvermeidung und Navigationsunterstützung beitragen können.

Die Tests umfassen u. a. folgende Szenarien:

- autonome Inspektionsflüge entlang von Infrastrukturen (z. B. Stromtrassen, Bahnlinien),

- Navigationsmanöver in urbanen Umgebungen mit hoher Hindernisdichte,

- operationelle Sicherheitsbewertungen (Specific Operations Risk Assessment – SORA) auf Basis von ADAM-Kartendaten,

- Integration von ADAM-Karten in bestehende Flight Management Systeme (FMS) und Ground Control Stations (GCS).

Parallel dazu wird eine Softwareplattform für das Kartenmanagement entwickelt, die Funktionen zur Datenfusion, Aktualisierung, Qualitätsprüfung und Distribution bietet.

Partner und Kompetenzen

Das Konsortium besteht aus folgenden Partnern:

- Das Fraunhofer IVI verantwortet die Gesamtkoordination sowie die Systemarchitektur und Validierung.

- Continental Automotive Technologies GmbH entwickelt Sensorschnittstellen und Datenverarbeitungsmodule für mobile Plattformen.

- Droniq GmbH integriert die Ergebnisse in bestehende UTM- und U-Space-Dienste.

- Die Technische Universität München (TUM) erforscht Navigationsstrategien, SLAM-Algorithmen und probabilistische Flugplanung.

- Sedenius Engineering GmbH, BIT Technology Solutions GmbH, PKTEC Pauli & Kayser Ingenieurgesellschaft mbH, Airclip Service GmbH & Co. KG und Autonom Elektrisch Fliegen gGmbH übernehmen Aufgaben in den Bereichen Softwareentwicklung, Sensorintegration und Testbetrieb.

Bedeutung und Ausblick

Während heutige Drohnen stark auf Echtzeit-Sensorik angewiesen sind, können zukünftige Systeme auf kontextuelle Karteninformationen zugreifen, die durch kontinuierliche Datenerfassung und KI-gestützte Aktualisierung immer präziser werden.

Dadurch eröffnen sich erhebliche Vorteile:

- Erhöhte Betriebssicherheit, da Redundanzen zwischen On-Board- und Off-Board-Daten entstehen.

- Zulassungserleichterungen, da standardisierte Kartenformate in sicherheitsrelevante Nachweise (z. B. SORA) eingebunden werden können.

- Effizienzgewinne, weil Flugrouten planbarer und risikoärmer werden.

- Grundlage für Urban Air Mobility, da skalierbare Infrastruktur entsteht.

Die Projektübersicht ist hier einzusehen: ADAM | Daten+ oder BMV - ADAM Advanced Airspace Mapping